Yapay Zekâ Artık İnsanlardan Ayırt Edilemiyor: GPT-4.5 ve LLaMa-3.1 Turing Testini Geçti

Yapay zekâ teknolojisinde çığır açan bir gelişme yaşandı. OpenAI’nin GPT-4.5 ve Meta’nın LLaMa-3.1 modelleri, ünlü Turing Testini başarıyla geçerek insanlardan ayırt edilemez seviyede konuşma yeteneği sergiledi. Bu tarihi başarı, yapay zekânın insan benzeri etkileşimlerde ulaştığı noktayı gözler önüne sererken, aynı zamanda teknolojinin geleceği hakkında önemli soruları da gündeme getiriyor.

Turing Testi ve Yapay Zekâ Evriminde Anlamı

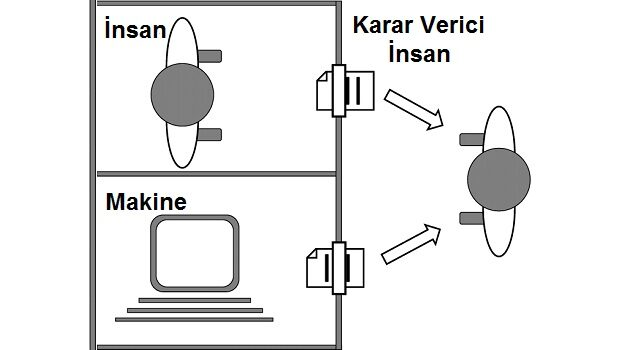

Alan Turing’in 1950 yılında ortaya attığı efsanevi test, bir makinenin gerçekten düşünebildiğini kanıtlamak için tasarlanmıştı. Basit ama etkili bir prensibe dayanan test, bir insanın karşısındakinin makine mi yoksa insan mı olduğunu ayırt edememesi durumunda başarılı sayılıyor. Yıllar boyunca pek çok yapay zekâ sistemi bu testi geçmeye çalıştı, ancak GPT-4.5 ve LLaMa-3.1 istatistiksel olarak anlamlı sonuçlarla bu hedefe ulaşan ilk modeller oldu.

GPT-4.5 %73’lik inanılmaz bir başarı oranı yakalayarak, testi uygulayanların çoğunluğunu insan olduğuna ikna etmeyi başardı. Meta’nın LLaMa-3.1 modeli ise %56’lık bir başarı gösterdi ki bu oran, normal insan katılımcıların performansıyla eşdeğer kabul ediliyor. Bu sonuçlar, doğal dil işleme teknolojilerinin son birkaç yılda ne kadar hızlı geliştiğinin çarpıcı bir kanıtı.

Araştırmacılar, sonuçların güvenilirliğini sağlamak için titiz bir çalışma yürüttü. Testlerde katılımcılar beşer dakikalık oturumlarla hem gerçek insanlarla hem de yapay zekâ sistemleriyle sohbet etti. İki farklı grup – üniversite öğrencileri ve profesyonel işgücü – tarafından yapılan bağımsız değerlendirmeler, sonuçların tutarlılığını güçlendirdi.

İlginç bir bulgu da GPT-4.5’nin bazı durumlarda gerçek insanlardan daha “insani” algılanması oldu. Bu paradoksal sonuç, yapay zekânın konuşma kalıplarını optimize ederken insanların rastgele hatalarını ve tutarsızlıklarını da modellemesinden kaynaklanıyor olabilir.

GPT-4.5 ve LLaMa-3.1’in başarısına rağmen, AI’nin gerçek dünya problemlerini çözme kapasitesi henüz tam olarak gelişmiş değil. Bu modeller insan gibi yanıtlar verebilse de hala insan zekâsı ve etik karar alma yeteneklerine sahip değiller. Ayrıca, bu tür AI sistemlerinin yanlış bilgi yayması, iş gücü kaybına yol açması ve sosyal izolasyonu tetiklemesi gibi endişeler de gündemde.

Yapay zekâ modelleri insan gibi konuşabilse de gerçek anlamda anlama yeteneğine sahip değil. Bu nedenle uzmanlar yeni ölçütlere ihtiyaç olduğunu belirtiyor.